原来Scaling Law还能被优化?Meta这招省token又提效

原来Scaling Law还能被优化?Meta这招省token又提效2017 年,一篇《Attention Is All You Need》论文成为 AI 发展的一个重要分水岭,其中提出的 Transformer 依然是现今主流语言模型的基础范式。尤其是在基于 Transformer 的语言模型的 Scaling Law 得到实验验证后,AI 领域的发展更是进入了快车道。

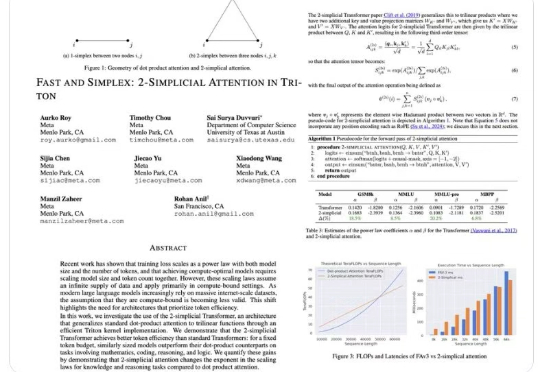

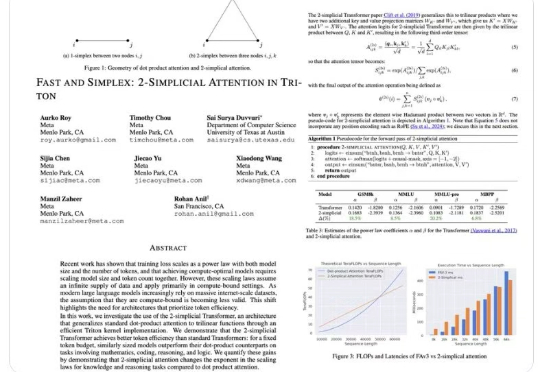

2017 年,一篇《Attention Is All You Need》论文成为 AI 发展的一个重要分水岭,其中提出的 Transformer 依然是现今主流语言模型的基础范式。尤其是在基于 Transformer 的语言模型的 Scaling Law 得到实验验证后,AI 领域的发展更是进入了快车道。

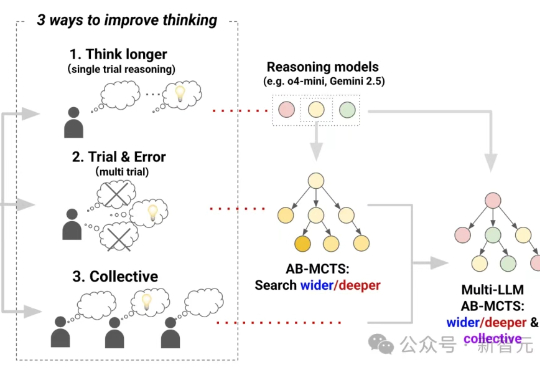

三个前沿AI能融合成AGI吗?Sakana AI提出Multi-LLM AB-MCTS方法,整合o4-mini、Gemini-2.5-Pro与DeepSeek-R1-0528模型,在推理过程中动态协作,通过试错优化生成过程,有效融合群体AI智慧。

现在再讨论 AI 写作,多少有点没劲:prompt 真的越来越像咒语了,越来越像一些神秘不可洞察的玄学技巧。这导致使用 AI 写东西的过程,不管是写什么类型的文字,过程都跟做法似的:赌指令能不能触发出一些好的生成。同时还得用大量的指令,去掉「AI味」。

不要让AI成为「垃圾制造机」。 谁能想到,一个 AI 生成的视频竟然在 ins 上拿下 2.52 亿次浏览量,仅点赞就达到 325.7 万次。

再聪明的机器也不能代替我们生活 从今年年初开始,美国一些专注于报道 AI 的记者们,陆陆续续接到邮件。这些邮件来自不同的人,内容却如出一辙:都是各种惊天大秘密。

你可能没发觉,AI 在很多地方都已经开始「替你创作」了。你最近听的歌、刷到的直播、点开的短片,背后可能并没有真实的「人」。

Jack Clark 是最关注和熟悉中国在芯片、计算和模型上进展的 AI Lab 领导人之一。他毫不吝啬对中国 AI 进展的认可,将 DeepSeek R1 视作“推理模型大范围扩散”的起点,近期又把 HyperHetero 使用的异构集群叫做通过“超级智能进行持续自我训练”的垫脚石。

这篇文章,我会从几个真实的案例出发,深度拆解一下星流这款产品,以及聊聊:为什么我认为「可控」才是真正的生产力?星流到底如何做到「可控」?以及,「可控性」为什么会是下一阶段 AIGC 的竞争关键?

AI竞争加剧下,Meta面临人才外流和模型性能瓶颈。扎克伯格启动"超级智能单元"招募顶尖AI人才失败后,转向企业风险投资(CVC),通过收购Scale AI和入股NFDG基金,旨在提升竞争力,但优质标的稀缺加剧市场挑战。

这个AI让打工人「磕头」致谢。 前段时间,我们报道了 5 款大模型参加了今年山东高考的事儿,为了弄清楚各大模型在 9 个科目中的具体表现,我们对着测评明细表挨个儿分析,搞得狼狈又崩溃。要是哪个 AI 能一键分析表格,我当场就能给它磕一个。